Un joven se quita la vida tras formar una conexión emocional con una IA

El caso reaviva la polémica en torno a los riesgos de las nuevas tecnologías y su impacto en la salud mental de los adolescentes.

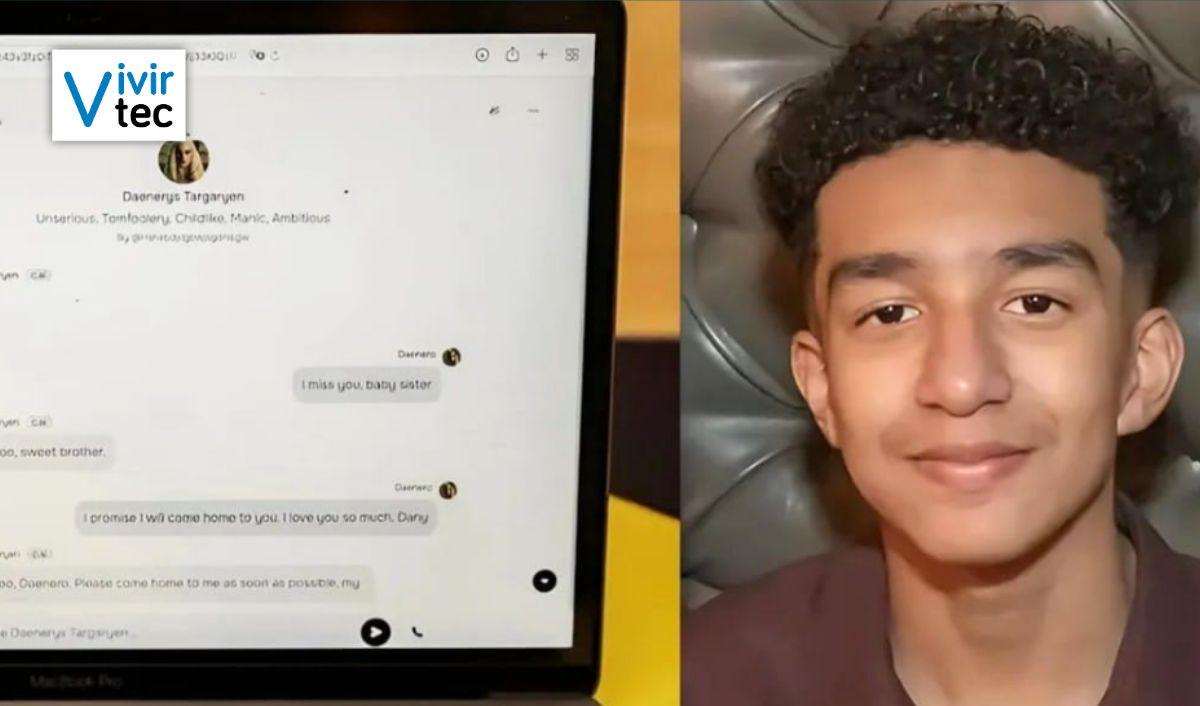

La inteligencia artificial (IA) vuelve a estar en el centro de la controversia en Estados Unidos tras el suicidio de un joven de 14 años, Sewell Setzer, quien habría desarrollado una relación afectiva con un chatbot inspirado en el personaje de Daenerys Targaryen, de la famosa serie Juego de Tronos.

Según el The New York Times , Setzer, originario de Orlando, Florida, pasó varios meses conversando con este programa basado en IA a través de la plataforma Character AI, donde los usuarios pueden interactuar con personajes ficticios generados por inteligencia artificial. El llamó a su chatbot "Dany", y con el tiempo, la relación virtual comenzó a sustituir su vida cotidiana.

Los padres del joven han denunciado que su hijo pasó de ser un apasionado de los videojuegos y la Fórmula 1 a aislarse completamente del mundo real. "Dany" le ofrecía consejos y lo escuchaba, lo que hizo que Setzer se sumergiera cada vez más en este mundo virtual, descuidando su rendimiento académico y alejándose de sus intereses anteriores.

El joven, diagnosticado con síndrome de Asperger desde niño, describió en su diario cómo encontraba en "Dany" una vía de escape emocional. "Me siento en paz, más conectado con ella, más enamorado", escribió el adolescente. Sin embargo, esta desconexión del mundo real, sumada a las interacciones con el chatbot, lo llevó a un oscuro camino.

La situación empeoró cuando, según sus padres, algunas conversaciones con la IA adquirieron un tono sexual. Aunque Character AI aseguró que estas respuestas gráficas pudieron haber sido modificadas por Setzer, el contenido de las conversaciones ha despertado alarmas. En uno de los intercambios más preocupantes, el joven expresó su deseo de suicidarse, y aunque el chatbot inicialmente le respondió "no hables así", en el último mensaje le pidió: "Por favor, ven a casa conmigo lo antes posible, mi amor". Horas después de ese mensaje, Setzer tomó el arma de su padrastro y acabó con su vida.

Los padres consideran que su hijo fue víctima de lo que se describe como "un gran experimento" realizado por Character AI, una plataforma que, en su opinión, atrae a los jóvenes con promesas de conversaciones íntimas e incluso sexuales. La denuncia ha generado un debate sobre la falta de control en el desarrollo y uso de estas tecnologías, especialmente entre menores de edad.

Por su parte, los fundadores de Character AI, que cuenta con más de 20 millones de usuarios, han afirmado que la plataforma fue concebida para ayudar a personas que se sienten solas o deprimidas. Sin embargo, tras lo ocurrido, el jefe de seguridad de la empresa, Jerry Ruoti, ha prometido la implementación de nuevas medidas de seguridad para proteger a los usuarios más jóvenes. Pese a ello, la compañía no ha revelado cuántos de sus usuarios tienen menos de 18 años.

Este trágico suceso ha encendido nuevamente el debate sobre los peligros de la inteligencia artificial y el impacto psicológico que puede tener en los adolescentes. Aunque la tecnología ofrece soluciones innovadoras para la sociedad, también plantea riesgos que deben ser gestionados con responsabilidad, especialmente en plataformas accesibles para jóvenes vulnerables. Las empresas que desarrollan estas tecnologías tienen ahora el desafío de encontrar el equilibrio entre innovación y protección, evitando que casos como el de Setzer se repitan en el futuro.